Berücksichtigung von Drittvariablen

Regressionsanalysen

Definition: Regressionsanalysen

Regressionsanalysen sind dem Median-Split und Extremgruppenvergleichen oftmals überlegen. Bei der Regressionsanalyse fließen die Drittvariablen als zusätzliche Prädiktoren in die Datenanalyse ein. Beispielsweise könnte die Lernleistung durch ein Regressionsmodell mit den Prädiktoren Intelligenz und Art der Lernumgebung (Lernumgebung A versus Lernumgebung B) vorhergesagt werden. Sofern die Prädiktorvariablen nicht intervallskaliert sind, müssen diese zuvor mittels Indikatorcodierung in eine künstlich erzeugte, intervallskalierte Variable umgewandelt werden (z.B. Bortz, 2005). Mit Hilfe von Regressionsanalysen können auch Interaktionseffekte zwischen den einzelnen Prädiktoren aufgedeckt werden (z.B. Moosbrugger, 2002).

Interaktionseffekt und Beispiel

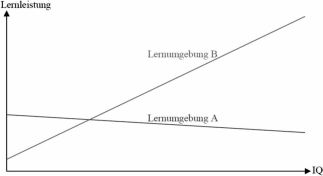

Als Interaktion oder Wechselwirkung bezeichnet man einen über die Haupteffekte (hier der Einfluss von Intelligenz und Art der Lernumgebung auf die Lernleistung) hinausgehenden Effekt. Dieser ist dadurch zu erklären, dass mit der Kombination einzelner Faktorstufen eine eigenständige Wirkung oder ein eigenständiger Effekt verbunden ist (z.B. Bortz, 2005). Ein Interaktionseffekt – auch Moderatoreffekt genannt – läge beispielsweise vor, wenn Versuchspersonen in Abhängigkeit ihrer Intelligenz unter den Lernumgebungen A und B unterschiedliche Lernleistungen erreichen. Denkbar wäre, dass mit ansteigender Intelligenz die Lernleistungen von Probanden in der Umgebung A geringfügig abnähmen, während Versuchsteilnehmer unter der Lernumgebung B mit zunehmender Intelligenz bessere Leistungen erzielen würden (Abbildung 29).

Vor- und Nachteile

Regressionsanalysen bieten den Vorteil, komplexe Zusammenhänge aufdecken zu können, ohne dass der Anwender eine besonders hohe statistische Expertise aufweisen muss. Zudem werden diese Analysen von allen gängigen Statistikprogrammen in zahlreichen Varianten (z.B. hierarchische Regressionsanalysen) unterstützt. Die Erfassung komplexer, nonlinearer Zusammenhänge mittels Regressionsanalysen erweist sich allerdings häufig als schwierig.

Neuronale Netze

Definition: Neuronale Netze

Innerhalb der E-Learning Forschung werden erhobene Daten mittels (künstlicher) neuronaler Netze derzeit nur sehr selten analysiert. Dabei weisen diese bei der Datenauswertung diverse Vorteile auf (z.B. Weber, 2001). Neuronale Netze stellen einen Oberbegriff dar, der zahlreiche, zum Teil sehr unterschiedliche, Modelle umfasst. Selbst traditionelle statistische Verfahren wie die Regressionsanalyse lassen sich als Spezialfälle neuronaler Netze beschreiben. Gemeinsam ist all diesen Netzen aber, dass Matrizenberechnungen durchgeführt werden und dabei Informationen aufgenommen, verarbeitet und ausgegeben werden. Bezüglich der Informationsaufnahme würde man bei dem oben aufgeführten Beispiel Versuchsperson für Versuchsperson die Faktorstufen der unabhängigen Variablen (z.B. Null für Lernumgebung A und Eins für Lernumgebung B) sowie weitere Drittvariablen (z.B. die Intelligenz des jeweiligen Probanden) bereitstellen. Diese Informationen würden durch das Netz (Abbildung 30) in mehreren Schritten verarbeitet und zugleich zu seiner Modifikation beitragen. Abschließend erfolgt die Informationsausgabe. So wird beispielsweise in Abhängigkeit der Lernumgebung (A oder B) und eines Intelligenzwertes die Lernleistung (abhängige Variable) vorhergesagt.

Beispiel

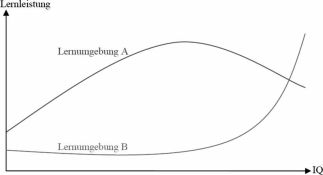

Abbildung 31 visualisiert ein fiktives Beispiel zur Datenauswertung mittels neuronaler Netze. Hiernach würden Probanden mittlerer Intelligenz unter Lernumgebung A bessere Lernleistungen erzielen als niedrig- oder hochintelligente Versuchsteilnehmer. Denkbar wäre, dass diese Lernumgebung A für weniger intelligente Versuchspersonen zu schwer und für hochintelligente Lerner zu leicht ist. Unter Lernumgebung B hingegen zeigen die meisten Benutzer eine ähnliche Lernleistung. Erst bei hoher Intelligenz nimmt die Lernleistung mit steigender Intelligenz der Probanden rasch zu. Erklärt werden könnte dieser erdachte Zusammenhang ebenfalls mit der Schwierigkeit: Lernumgebung B ist für die meisten Versuchsteilnehmer zu schwierig. Erst ab einer gewissen Intelligenzleistung entfaltet diese (komplexe) Lernumgebung ihr Potential.

Vor- und Nachteile

Neuronale Netze besitzen den Vorteil, komplexe, nonlineare Zusammenhänge im Datensatz aufdecken zu können (Rey und Wender, 2008). Zwar können derartige Zusammenhänge ebenfalls mit Hilfe des Allgemeinen Linearen Modells (ALM) detektiert werden (z.B. Moosbrugger, 2002), jedoch ist dort die Vorgabe eines spezifischen Modellterms (z.B. x²) notwendig. Auch andere komplexe Zusammenhänge lassen sich mittels neuronaler Netze mitunter besser aufdecken als mit herkömmlichen statistischen Verfahren. Zu beachten ist dabei, dass sich diese traditionellen Verfahren mathematisch auch als Spezialfälle neuronaler Netze darstellen lassen und es sich somit beispielsweise bei der Regressionsanalyse ebenfalls um ein neuronales Netz handelt. Nachteilig bei neuronalen Netzen im Rahmen der Datenauswertung sind die häufig schwierige Interpretation der komplexen, nonlinearen Zusammenhänge und die benötigte Expertise des "Netzwerkarchitekten". Zudem werden neuronale Netze nicht von allen Statistikprogrammen unterstützt. Darüber hinaus ist die Gefahr des Overfittings der Daten besonders groß (Rey und Wender, 2008).

Problem: Overfitting

Das Problem des Overfittings wird in der Literatur auch als capitalization on chance oder Bias-Varianz-Dilemma bezeichnet. Dieses Problem tritt auf, wenn zufällige Variationen im (Trainings-)Datensatz durch das Modell und deren unabhängige Variablen miterfasst werden. In diesem Fall prognostiziert das neuronale Netz zwar die Daten der ursprünglich untersuchten Stichprobe sehr gut, nicht aber die Messwerte einer neuen Stichprobe. Eine Verallgemeinerung des Modells auf die Grundgesamtheit ist folglich nicht statthaft (Rey und Wender, 2008). Dem Problem kann durch Replikation (Wiederholung) des Versuchs oder Kreuzvalidierung begegnet werden. Bei der Kreuzvalidierung wird die Stichprobe in zwei Untergruppen unterteilt:

- Trainingsmenge: Diese Teilstichprobe dient zur Berechnung des (Vorhersage-)Modells.

- Validierungsmenge: Diese Teilmenge wird nicht zur Berechnung, sondern ausschließlich zur Überprüfung des Modells herangezogen.

Drittvariablen II

Drittvariablen II